実写したフェンスを Maya でモデリングしたフェンスと置き換えると想定します。実写映像では、カメラがフェンスを見回しています。ライブを使用すると、モデリングしたフェンスを実写映像のカメラと同じように見回す Maya カメラをアニメートすることができます。Maya で作成したフェンスをこのカメラからレンダーすると、カメラのパース ビューは実写したフェンスと同じになります。したがって、フェンスとカメラを正確に合成することができます。

ライブでは、実写映像のオブジェクトの動きを一致させることもできます。実写映像上で動いている人の帽子を Maya で作成した帽子で置き換えるとします。ライブを使用すると、実写した帽子の特定のポイントの動きに追従する 3D ロケータを作成できます。そして、Maya で作成した帽子をロケータの移動ポイントにアタッチすると、レンダーした Maya の帽子が実写した人の動きに追従するようになります。オブジェクトの動きを一致させる手順は、カメラを一致させる手順とほぼ同じです。

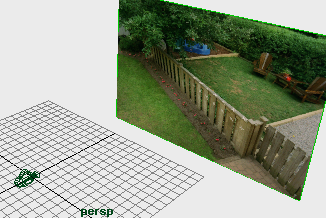

最初に、実写映像のデジタル イメージを読み込みます。このレッスンでは、フィルム素材からスキャンしたイメージを使用します。

イメージは、イメージ プレーン上に表示されます。このプレーンは Maya カメラの一部であり、イメージをバックグラウンドの一部として表示します。